Een les(je) AI

TL;DR:

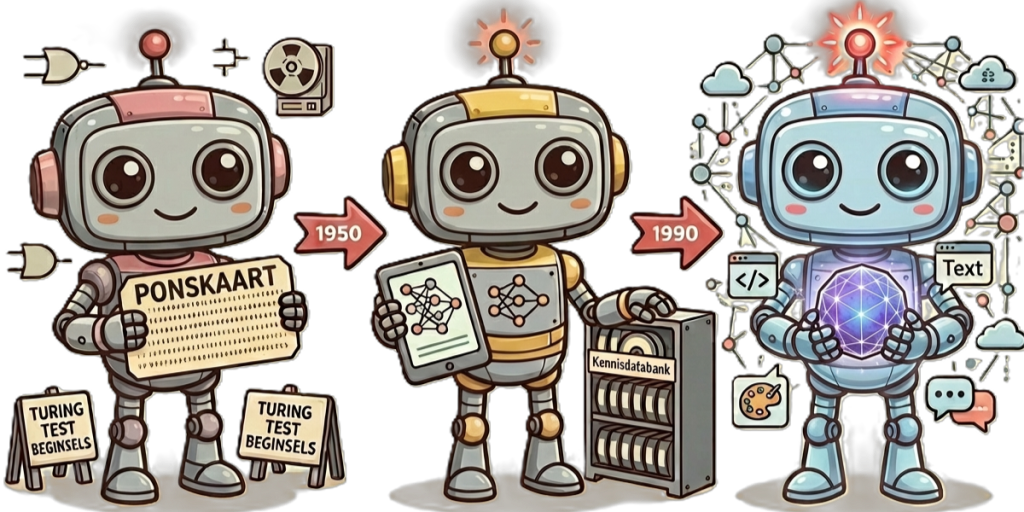

AI is niet ineens ontstaan. Het is een reeks van mislukkingen, hoop en doorbraken over 70 jaar tijd. Twee keer dachten wetenschappers dat ze het hadden gekraakt, twee keer stortte alles in. Tot alles wat onderzoekers, ingenieurs en bedrijven opgebouwd hadden, zich combineerde: genoeg data, snelle computers en de juiste architectuur. En toen, op één dag, werd ChatGPT opgesteld aan iedereen en miljoenen mensen realiseerden zich dat AI niet de toekomst is, maar het hier en nu. Dit is het verhaal van hoe we tot hier kwamen: van droom naar werkelijkheid.

1950

Filosofische grondslag

Alan Turing: “Kunnen machines denken?”

In oktober 1950 publiceerde de briljante wiskundige Alan Turing een baanbrekend artikel in het filosofische journal ‘Mind’ met de titel: Computing Machinery and Intelligence.

Turing stelde de cruciale vraag: Kunnen machines denken? Doordat denken moeilijk te definiëren is, verving hij deze vraag met iets praktischer: Kunnen machines zo goed het ‘imitation game’ spelen dat je niet kunt zeggen of het een mens of een machine is?

Dit werd bekend als de Turing Test. Het idee was simpel maar diepzinnig: Als een machine zich precies gedraagt als een intelligent mens, waarom zouden we zeggen dat het niet intelligent is?

Turing voorspelde optimistisch dat tegen het einde van de 20ste eeuw machines inderdaad dit spel zouden kunnen winnen.

De Dartmouth Summer Research Project

Zes jaar na Turing’s denkoefening verzamelden de slimste onderzoekers zich aan Dartmouth College met een concreet doel: kunnen we eigenlijk machines maken die intelligent zijn?

Het werd een onderzoeksconferentie waarin men ideeën over denkende machines wilden verduidelijken en verder ontwikkelen.

John McCarthy, professor aan Dartmouth College en drijvende kracht achter de conferentie, introduceerde de naam ‘Artificial Intelligence’ voor dit nieuwe onderzoeksveld.

1956

Een nieuw wetenschapsgebied

Jaren ’60

–

vroege jaren ’70

Automatisering

De eerste golf: machines voeren taken uit

Na Dartmouth begonnen computers ‘eindelijk’ echt nuttig te worden. Niet door intelligent te zijn, maar door repetitieve taken automatisch uit te voeren.

In deze periode werden computers steeds beter in het volgen van vaste regels. ‘Als je dit patroon ziet, doe dat.’ Deze systemen waren betrouwbaar maar star. Ze konden alleen doen wat vooraf geprogrammeerd was.

Ondertussen richtte onderzoek zich op ‘symbolische AI’, het idee dat intelligentie kon worden bereikt door voldoende kennis en regels in een computer te zetten.Onderzoekers als Allen Newell en Herbert Simon ontwikkelden programma’s die logica-puzzels konden oplossen en problemen stap voor stap konden doordenken.

De sfeer was optimistisch: veel onderzoekers dachten dat menselijke intelligentie, als ze het maar goed genoeg konden formuleren, voor machines bereikbaar zou zijn.

Eerste AI winter: De grote crash

Midden-jaren 1970 begon het duidelijk te worden dat de vroege beloften niet waargemaakt kon worden. Veel AI-programma’s die op papier vooruitstrevend leken, faalden volledig op realistische problemen. Zo konden Logica-gebaseerde systemen niet omgaan met onzekerheid en nuance in de echte wereld.

In 1973 publiceerde Sir James Lighthill een rapport dat AI bekritiseerde en men concludeerde dat het niet meer heeft bereikt dan andere wetenschappen. Dit rapport was verwoestend en bedrijven trokken zich uit het veld terug. Veel onderzoekers verloren hun banen en AI-labs sloten.

Deze periode wordt de ‘eerste AI winter’ genoemd, een periode van verminderde financiering, verminderde interesse en stagnatie.

1974

–

1980

Desillusionering

1980

Expert Systems

Korte opleving: Computers die experts nabootsen

In de jaren 1980 gebeurde iets bijzonders. Bedrijven begonnen te zien dat computers menselijke expertise konden vastleggen in regels. Dit zag er zo veelbelovend uit dat overheden en bedrijven opnieuw massaal geld pompten in onderzoek.

Een “expert system” was een programma dat specifieke domeinkennis had (bijvoorbeeld medische diagnose) en die kennis kon gebruiken om aanbevelingen te doen.

AI voelde niet langer als een mislukt experiment, maar als een serieuze bedrijfstak. De sfeer was opnieuw optimistisch.

Tweede AI winter: Expert Systems falen masaal

Tegen 1987 werd echter duidelijk dat expert systems veel minder wonderbaarlijk waren dan gedacht. De systemen bleken extreem duur om te onderhouden. Elke keer dat kennis veranderde, moest het hele systeem worden herschreven.

Systemen gaven fouten als ze met iets onverwachts werden geconfronteerd en konden alleen opgegeven kennis reproduceren. Bovendien kon één enkel systeem maar heel klein domein dekken. Een systeem dat medische diagnose kon verrichten, kon niet plotseling technische problemen oplossen. De climax kwam rond 1987-1988 toen veel bedrijven faalden die LISP machines (gespecialiseerde computers voor AI) bouwden. Apple en Sun Microsystems introduceerden algemene workstations die dezelfde prestaties konden bereiken voor een fractie van de prijs.

Dit leidde tot de ‘tweede AI winter’, opnieuw een periode van afnemende interesse, verminderde financiering en veel werkloosheid voor AI-onderzoekers.

1980

–

vroege jaren ’90

Desillusionering deel 2

Late jaren ’90

–

2000

Stille voorbereiding

Het internet groeit; machine learning wint terrein

Terwijl AI-financiering en -interesse afnamen, groeide het internet exponentieel. Miljarden webpagina’s werden online gezet, miljarden transacties gebeurden digitaal en miljarden foto’s werden gedeeld. Deze gigantische hoeveelheid data zou later van onschatbare waarde blijken.

Ondertussen begonnen onderzoekers zich af te vragen: in plaats van alle kennis vooraf in te voeren (symbolische AI), wat als we computers miljoenen voorbeelden gaven en ze zelf laten ontdekken welke patronen belangrijk zijn?

Dit idee leidde tot een nieuwe benadering: machine learning. Diverse statistische benaderingen begonnen successen te boeken, met name in beperkte domeinen. In 1997 versloeg IBM’s Deep Blue, Grootmeester schaker Garry Kasparov. Een symbolisch moment dat toonde dat computers complexe problemen konden oplossen, hoewel niet op dezelfde manier als mensen.

Geoffrey Hinton begon in de late ’90 onderzoek naar neurale netwerken met meerdere lagen. wat later “deep learning” zou heten. De ’90 voelden als een woestijn voor AI ontwikkeling, maar waren in feite de zaaiing voor de volgende opleving.

Computers leren patronen herkennen van data

In het begin van 2000 gebeurde wat nodig was: het Internet was groot genoeg, computers waren voldoende krachtig en wiskundigen hadden de juiste algoritmes bedacht.

- Spamfilters leerden van miljarden e-mails welke kenmerken spam aangaven. (al vanaf de jaren ’90)

- Netflix bouwde aanbevelingssystemen die jouw kijkgeschiedenis gebruikten om films voor te stellen die daarbij aansloten. (2000-2007)

- Google Translate begon volledige zinnen te vertalen in plaats van alleen woorden op te zoeken. (2006-2016)

Dit was allemaal mogelijk, omdat computers miljarden voorbeelden konden analyseren en zelf patronen konden ontdekken. Dit werd Machine Learning genoemd. In plaats van als-dan, kreeg het de instructies: observeer patronen en leer ervan.

De begin jaren van 2000 hadden geen grote doorbraken in het nieuws, geen hype, maar wel een enorme praktische vooruitgang.

2000

–

2010

Machine Learning Era

2010

Deep Learning

Neurale netwerken komen terug

Rond 2010 vonden drie onafhankelijke ontwikkelingen toevallig tegelijk plaats: gigantische datasets (YouTube, Facebook, internet), krachtige hardware (GPUs – grafische processoren), en beter inzicht in hoe je neurale netwerken kon trainen.

Een neuraal netwerk is een computersysteem dat net als je brein werkt, maar veel eenvoudiger. Je geeft voorbeelden. Het systeem ontdekt zelf welke kenmerken belangrijk zijn om patronen en/of objecten te identificeren.

2012 was een keerpunt: AlexNet won de ImageNet competitie met indrukwekkende marge door diep neurale netwerken te gebruiken voor afbeeldingsherkenning. Dit inspireerde een golf van onderzoek.

2010 is het begin van de “gouden eeuw” van AI. Deep learning, machines met veel lagen neurale netwerken hadden doorbraak na doorbraak bereikt in alles van spraakherkenning, afbeeldingherkennig tot machinevertaling.

Transformers: “Attention is all you need”

Op 12 juni 2017 publiceerden Google-onderzoekers een essay dat alles zou veranderen: “Attention is all you need”. Dit introduceerde de Transformer architectuur, een volledig nieuw soort neuraal netwerk gebaseerd op attention mechanismen (een methode om te bepalen welke woorden voor elkaar het meest relevant zijn, zodat het model snapt welke informatie echt belangrijk is).

Transformers waren revolutionair, omdat ze:

• Hele zinnen tegelijk konden verwerken (in plaats van woord-voor-woord)

• Snellere computers zijn die veel berekeningen tegelijk konden doen

• Betere resultaten bereikten voor taal

Dit was het fundament waarop vrijwel alle moderne taalmodellen zijn gebouwd. Zonder transformers zou Generatieve AI niet mogelijk zijn geweest.

12 juni 2017

De Technologie

2018

–

2022

Voorbereiding

Opbouw naar Generatieve AI

Na de Transformer doorbraak in 2017 begonnen onderzoekers steeds grotere taalmodellen te trainen. 2018: OpenAI lanceerde GPT. 2020: GPT-3 met 175 miljard parameters, getraind op 45 terabytes tekst. Google lanceerde BERT. Meta experimenteerde met grote modellen.

Ook afbeeldingen kregen aandacht: DALL-E (van OpenAI) kon in 2021 afbeeldingen genereren op basis van tekstbeschrijvingen. Ze waren indrukwekkend voor onderzoekers, maar voor het grote publiek zat het nog achter een betaalmuur.

Belangrijk: Dit waren de “proof of concept” jaren. De technologie was klaar. Nu hoefde het alleen nog in de handen van de rest van de wereld.

ChatGPT: AI voor iedereen

Op 30 november 2022 deed OpenAI iets onverwachts: ze maakten AI openbaar toegankelijk.

ChatGPT werd losgelaten op de wereld. Niet als een onderzoekstool. Niet als bedrijfssoftware. Gewoon… een chatbot met wie je kon praten.

Het gebruik groeide ongelooflijk snel:

• 5 dagen: 1 miljoen gebruikers

• 2 maanden: 100 miljoen gebruikers

Ter vergelijking: Instagram deed 2,5 jaar over 100 miljoen gebruikers en TikTok had 9 maanden nodig.

Plotseling was AI voor iedereen. Het kon vragen beantwoorden, essays schrijven en zelfs code genereren. Voor het eerst voelde AI voor het grote publiek echt “intelligent”.

Ironie der geschiedenis: 72 jaar nadat Alan Turing zijn imitation game voorstelde, kon een machine het echt goed doen. Velen zeiden dat ChatGPT eindelijk de Turing Test had gepasseerd.

30 november 2022

De doorbraak

2023

–

Nu

Generatieve AI Explosie

Iedereen bouwt aan AI; vragen ontstaan over toekomst

Na ChatGPT’s succes reageerden alle grote tech-bedrijven. Google lanceerde Bard (later Gemini). Meta opende hun Llama-modellen. Anthropic lanceerde Claude. Stability AI lanceerde afbeeldingsgeneratoren. Behalve modellen lanceren begonnen bedrijven AI overal in te bouwen: je telefoon, je e-mail, je spreadsheets, je code editor.

Tegelijk groeide de discussies over hallucinaties (verzinsels vanuit Generatieve AI die als waarheden worden gepresenteerd), copyright, banen, milieu-impact, en meer.

Nu is het de beurt aan Agentic AI. Agentic AI combineert het beste van twee werelden: de doelgerichtheid van klassieke AI (die taken plant en besluiten neemt) met de creativiteit van generatieve AI (die tekst, code, afbeeldingen maakt).